La inteligencia artificial está empezando a transformar muchas áreas de la tecnología, y los videojuegos no son una excepción. Durante años, la evolución gráfica ha dependido principalmente de un factor: tener hardware cada vez más potente. Más núcleos, más memoria, más capacidad de cálculo. Sin embargo, en los últimos tiempos ha empezado a aparecer un enfoque diferente que promete cambiar esa lógica. Se llama neural rendering, o renderizado neuronal.

Detrás de este concepto hay una idea sencilla pero muy potente. En lugar de calcular cada píxel de una imagen utilizando únicamente matemáticas tradicionales, los motores gráficos pueden apoyarse en redes neuronales capaces de aprender cómo debería verse una escena y reconstruirla mediante inteligencia artificial.

Puede parecer un detalle técnico, pero en realidad supone un cambio profundo. Si esta tecnología se desarrolla como esperan las grandes compañías del sector, podría marcar el inicio de una nueva etapa en la evolución gráfica del videojuego.

Del renderizado clásico a la inteligencia artificial

Para entender qué significa exactamente el neural rendering conviene repasar brevemente cómo funcionan los gráficos actuales.

Cuando un videojuego genera una imagen en pantalla, el motor gráfico tiene que calcular muchos elementos distintos al mismo tiempo: geometría, iluminación, texturas, sombras o reflejos. Todo ese proceso se conoce como renderizado. Durante décadas se ha basado principalmente en técnicas como la rasterización o el ray tracing, que simulan el comportamiento de la luz mediante cálculos matemáticos.

Este enfoque ha permitido avances espectaculares. Los videojuegos actuales pueden recrear mundos enormes con iluminación compleja y materiales cada vez más realistas. El problema es que cada salto visual exige más potencia y más recursos de desarrollo.

Aquí es donde entra el neural rendering.

En lugar de calcular cada elemento de la imagen desde cero, una red neuronal puede aprender a partir de miles o millones de ejemplos cómo se comporta la luz, cómo se ven determinados materiales o cómo debería reconstruirse una imagen de mayor calidad. Con esa información, la inteligencia artificial puede completar o mejorar parte de la escena final.

En otras palabras, el sistema ya no depende únicamente de cálculos físicos. También puede aprovechar lo que ha aprendido la IA para generar imágenes más complejas de forma más eficiente.

Un cambio que ya está empezando a notarse

Aunque el término neural rendering puede sonar futurista, en realidad ya está empezando a aparecer en algunas tecnologías actuales.

Uno de los ejemplos más conocidos es DLSS, la tecnología de escalado inteligente desarrollada por NVIDIA. Este sistema utiliza redes neuronales para reconstruir una imagen de alta resolución a partir de otra renderizada a menor resolución.

En la práctica, el juego se calcula internamente con menos carga gráfica. Después, la inteligencia artificial analiza la escena y genera una versión final con más detalle y nitidez. El resultado es que el jugador obtiene una imagen muy similar a la resolución nativa, pero con un rendimiento mucho mayor.

Este tipo de técnicas híbridas se han vuelto especialmente importantes con la llegada del ray tracing, que es una tecnología muy exigente en términos de potencia. Gracias a la inteligencia artificial, es posible mantener efectos gráficos avanzados sin sacrificar demasiados fotogramas por segundo.

DLSS no es el único ejemplo. AMD ha desarrollado tecnologías similares como FSR, y cada vez más estudios están experimentando con métodos de renderizado que combinan gráficos tradicionales con aprendizaje automático.

El potencial real del renderizado neuronal

La razón por la que muchas compañías están apostando por este enfoque es sencilla: el neural rendering abre la puerta a una forma distinta de generar gráficos.

Hasta ahora, la industria ha seguido una lógica bastante clara. Para lograr más realismo, se necesitaba más potencia de cálculo. Esto ha llevado a consolas y tarjetas gráficas cada vez más complejas y caras.

La inteligencia artificial permite romper parcialmente esa dependencia.

Si una red neuronal puede generar parte de la imagen final o reconstruir detalles que no han sido calculados directamente, el hardware puede dedicar menos recursos a tareas extremadamente pesadas. En algunos escenarios, esto puede traducirse en un aumento notable del rendimiento o en la posibilidad de crear escenas mucho más complejas.

También tiene implicaciones importantes para los estudios de desarrollo. Muchas tareas visuales que hoy requieren mucho trabajo manual podrían automatizarse parcialmente. Por ejemplo, la IA puede ayudar a generar variaciones de texturas, mejorar materiales o añadir detalles en tiempo real según la distancia del jugador.

Esto no significa que los artistas vayan a desaparecer. Lo más probable es que ocurra lo contrario: al eliminar parte de las tareas más repetitivas, los equipos creativos podrán centrarse más en el diseño artístico y menos en el trabajo técnico.

El papel del hardware especializado

El desarrollo del neural rendering está muy ligado a la evolución del hardware gráfico. Las GPUs modernas ya incluyen unidades dedicadas a inteligencia artificial capaces de ejecutar redes neuronales dentro del propio pipeline gráfico.

En el caso de NVIDIA, estas unidades se conocen como Tensor Cores, y permiten realizar cálculos de aprendizaje profundo directamente en la tarjeta gráfica. Esto es lo que hace posible tecnologías como DLSS o la generación de fotogramas mediante IA.

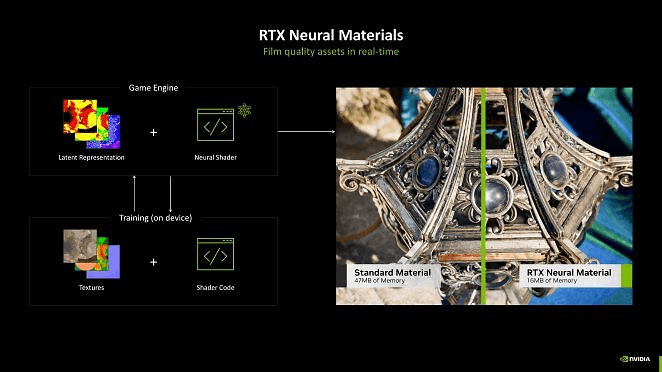

Con el tiempo están apareciendo también nuevos conceptos como los neural shaders, que utilizan redes neuronales para calcular materiales complejos, o sistemas de compresión de texturas basados en aprendizaje automático. La idea es que la inteligencia artificial participe cada vez más en el proceso de generación de imágenes.

Algunos investigadores incluso plantean un escenario en el que gran parte de los píxeles que vemos en pantalla no se calculen de forma tradicional, sino que sean generados o reconstruidos por redes neuronales entrenadas específicamente para gráficos en tiempo real.

La relación con las consolas del futuro

El interés por esta tecnología no se limita al mundo del PC. También está empezando a aparecer en el diseño de nuevas plataformas de hardware.

Diversas filtraciones sobre la futura consola de Microsoft, conocida internamente como Project Helix, apuntan precisamente a un fuerte enfoque en inteligencia artificial y renderizado neuronal. La idea sería integrar unidades especializadas capaces de aplicar estas técnicas directamente a nivel de sistema.

Si este enfoque se confirma, las consolas podrían utilizar IA para mejorar juegos antiguos, optimizar el rendimiento en tiempo real o generar gráficos más complejos sin aumentar demasiado el consumo energético.

Esto encaja con una tendencia que empieza a verse en toda la industria tecnológica. Durante años, la evolución del hardware ha estado centrada en aumentar la potencia bruta. Ahora, cada vez más dispositivos incluyen aceleradores dedicados a inteligencia artificial.

En el caso del gaming, esto podría significar que el futuro de los gráficos no dependa únicamente de GPUs más grandes, sino de sistemas capaces de combinar potencia tradicional con inteligencia artificial.

Un cambio comparable a otras revoluciones del videojuego

La historia de los videojuegos está marcada por varios saltos tecnológicos que han redefinido lo que era posible en cada momento. La llegada de los gráficos 3D, la introducción de los shaders programables o la aparición del ray tracing son algunos de los ejemplos más claros.

El neural rendering podría convertirse en el siguiente gran paso.

No se trata únicamente de mejorar la calidad visual. También implica cambiar la forma en que se generan los gráficos, la manera en que trabajan los estudios y el tipo de hardware necesario para ejecutar los juegos.

Si las previsiones del sector se cumplen, la inteligencia artificial podría convertirse en una parte esencial del proceso gráfico durante la próxima década.

Quizá dentro de unos años muchos jugadores ni siquiera piensen en ello. Simplemente verán mundos más grandes, personajes más realistas y escenarios más complejos. Pero detrás de esa evolución habrá algo diferente a lo que hemos tenido hasta ahora.

Parte de esos píxeles ya no estarán calculados solo por la GPU. También habrán sido imaginados por una inteligencia artificial.