Sora OpenAI es la herramienta de vídeo generativo más esperada del momento, pero todavía no está disponible en España ni en la mayoría de países europeos. Su capacidad para crear escenas completas a partir de descripciones ha generado una gran expectación, y su despliegue sigue siendo progresivo y muy limitado. Mientras Estados Unidos prueba la tecnología en entornos controlados, Europa espera una versión más regulada y madura.

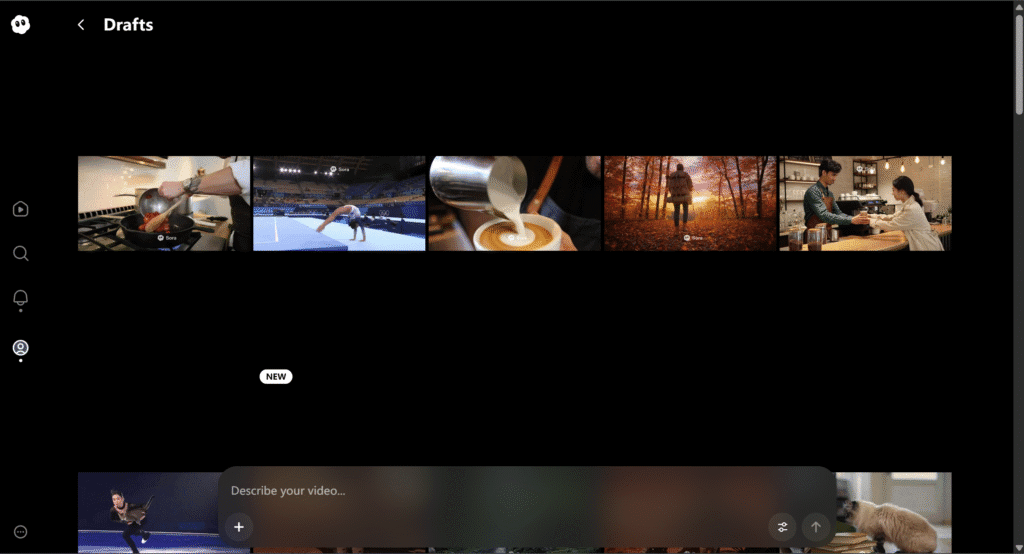

El modelo no funciona como un generador de vídeo convencional. Su base es una arquitectura capaz de interpretar la lógica interna de un relato, desde las relaciones entre objetos a la continuidad espacial, pasando por la simulación de materiales y efectos físicos. Cuando Sora acierta, el resultado sorprende: planos fluidos, composiciones elaboradas y un nivel de detalle que se acerca al lenguaje cinematográfico. Cuando falla, lo hace por motivos también reveladores. La tecnología aún muestra limitaciones en aspectos como la naturalidad del movimiento humano, la interacción precisa entre objetos o la coherencia visual en secuencias prolongadas. Son fallos que indican tanto el potencial del sistema como la distancia que todavía separa a estos modelos de un uso totalmente profesional.

Al otro lado está la cuestión de la seguridad. OpenAI ha diseñado Sora como un proyecto con restricciones estrictas, precisamente porque su capacidad para generar imágenes con apariencia realista tiene implicaciones directas en ámbitos como la verificación informativa, la identidad digital o la creación de contenido sensible. Por eso la compañía ha optado por un desarrollo controlado, centrado de momento en entornos de prueba y análisis de riesgos.

Dónde funciona Sora hoy, qué la diferencia de otros modelos y cuándo llegará a España

La pregunta más repetida en España y en buena parte de Europa es si Sora está disponible fuera de Estados Unidos. La respuesta, por ahora, sigue siendo negativa. El acceso permanece restringido a un número reducido de creadores, cineastas e investigadores norteamericanos que participan en programas piloto. Allí se está evaluando cómo se comporta el modelo en escenarios reales, desde preproducciones audiovisuales hasta pruebas de animación, siempre en un entorno supervisado. Este despliegue limitado no responde solo a cuestiones técnicas, sino también regulatorias. La legislación europea exige garantías adicionales relacionadas con trazabilidad, transparencia y protección frente a usos indebidos. Para OpenAI, cualquier lanzamiento en el continente debe cumplir antes estas obligaciones, lo que retrasa inevitablemente su expansión internacional.

Mientras tanto, Sora destaca entre sus competidores por dos factores esenciales: la amplitud de las escenas que puede generar y la coherencia interna de los planos. Otros modelos ofrecen resultados rápidos y vistosos, pero suelen centrarse en clips breves o en animaciones con un estilo más estilizado. Sora, en cambio, aspira a reconstruir fragmentos completos de un relato audiovisual siguiendo patrones reconocibles del cine y la animación. Esa ambición es lo que ha generado tanta expectación, pero también lo que obliga a OpenAI a extremar la prudencia antes de abrir el acceso al público general.

En cuanto a fechas concretas para España, no existe todavía un anuncio oficial. Todo apunta a que la disponibilidad llegará solo cuando exista una versión más madura, algo que muchos ya interpretan como la futura iteración del modelo, conocida de forma informal como “Sora 2”. Será entonces cuando OpenAI pueda presentar una herramienta técnicamente más estable, con controles de seguridad más estrictos y un sistema de marcado de contenido sintético que satisfaga las exigencias europeas. Si continúa la tendencia actual, es razonable pensar en un despliegue internacional progresivo que podría prolongarse hasta bien entrado 2026.

Lo que está claro es que la llegada de Sora a España no será simplemente la activación de un servicio, sino el inicio de un nuevo marco creativo. Su impacto en la producción audiovisual, la publicidad, la animación o el diseño narrativo podría ser tan profundo como lo fue en su momento la irrupción de los modelos de generación de texto. De ahí que la industria siga observando cada paso con atención, consciente de que la tecnología no solo transformará la forma de producir, sino también la de imaginar imágenes en movimiento.